openclaw安装

OpenClaw是一款开源、自托管、多渠道的AI智能体执行网关,核心是让大语言模型真正动手操控你的设备,完成自动化任务。

核心特点与本质

- 定位:连接大语言模型、通讯渠道与系统工具的执行中枢,而非仅对话的AI。

- 本质:让AI从“动口”(回答问题)升级为”动手”(执行任务),完成自动化任务,成为你的数字员工/自动化管家。

准备工作

- 环境准备:需要安装Node22+版本、Git。

- 安装openclaw。

- 配置模型:需要配置大语言模型的API密钥,用于调用模型。

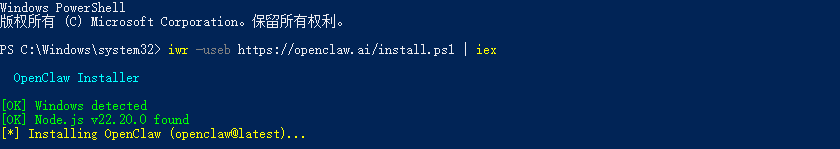

安装

因为openclaw是一个Node.js项目,所以需要先安装Node.js22+版本。

可以使用nvm作为Node.js版本管理工具,安装Node.js22+版本。

nvm install 22# 安装openclaw, 需要管理员权限

iwr -useb https://openclaw.ai/install.ps1 | iex下载可能有些慢,请耐心等待。

运行openclaw -v,如果显示版本号,说明安装成功。

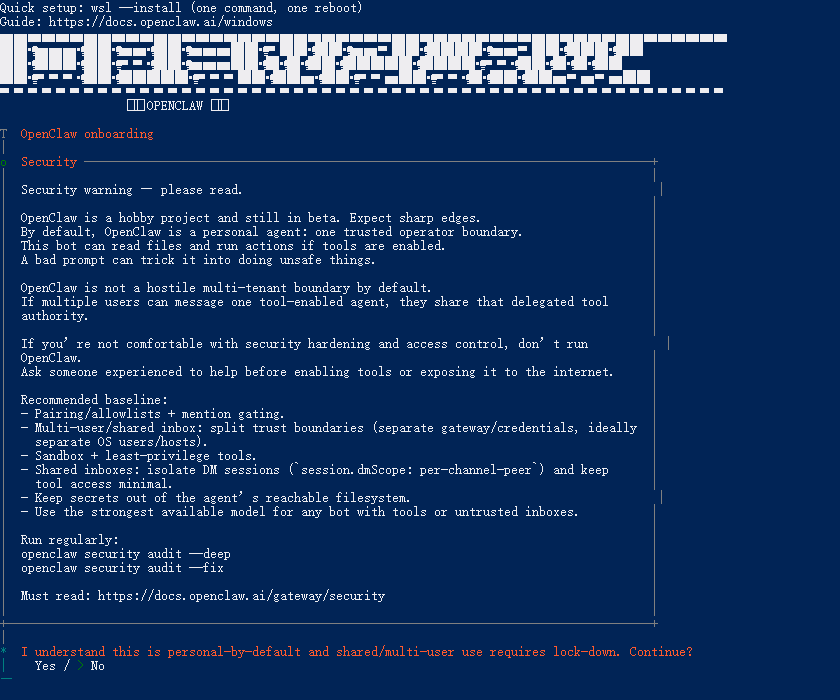

运行新用户向导

openclaw onboard --install-daemon

1. 模式选择

- YES:个人使用

- NO:多人使用

选择YES,个人使用。

2. 选择 Onboarding 模式

- QuickStart:快速安装默认配置,推荐新手

- Manual:手动配置每项参数,适合高级用户

选择QuickStart,快速安装默认配置,推荐新手。

3. 选择模型/服务提供商

OpenAI (Codex OAuth + API key)

Anthropic

Chutes

vLLM

MiniMax

Moonshot AI (Kimi K2.5)

Google

xAI (Grok)

Mistral AI

Volcano Engine

BytePlus

OpenRouter

Kilo Gateway

Qwen

Z.AI

Qianfan

Copilot

Vercel AI Gateway

OpenCode Zen

Xiaomi

Synthetic

Together AI

Hugging Face

Venice AI

LiteLLM

Cloudflare AI Gateway

Custom Provider

Skip for now暂时选择Skip for now,后续再配置。

4. 筛选模型供应商

All providers

amazon-bedrock

anthropic

azure-openai-responses

cerebras

github-copilot

google

google-antigravity

google-gemini-cli

google-vertex

groq

huggingface

kimi-coding

minimax

minimax-cn

mistral

openai

openai-codex

opencode

opencode-go

openrouter

vercel-ai-gateway

xai

zai选择All providers,包含所有模型供应商。

5. 选择默认模型

Keep current (default: anthropic/claude-opus-4-6)

Enter model manually

amazon-bedrock/anthropic.claude-3-haiku-20240307-v1:0

amazon-bedrock/anthropic.claude-3-5-haiku-20241022-v1:0

amazon-bedrock/anthropic.claude-haiku-4-5-20251001-v1:0

amazon-bedrock/eu.anthropic.claude-haiku-4-5-20251001-v1:0

...选择Keep current,保持默认模型。

前面3、4、5步,都是用于配置模型,后续可以重新配置。

6. 选择通讯渠道

Telegram (Bot API) (recommended · newcomer-friendly)

WhatsApp (QR link)

Discord (Bot API)

IRC (Server + Nick)

Google Chat (Chat API)

Slack (Socket Mode)

Signal (signal-cli)

iMessage (imsg)

LINE (Messaging API)

Feishu/Lark (飞书)

Nostr (NIP-04 DMs)

Microsoft Teams (Bot Framework)

Mattermost (plugin)

Nextcloud Talk (self-hosted)

Matrix (plugin)

BlueBubbles (macOS app)

Zalo (Bot API)

Zalo (Personal Account)

Synology Chat (Webhook)

Tlon (Urbit)

Skip for now选择Skip for now,后续再配置。

7. 选择搜索提供商

Brave Search (Structured results · country/language/time filters)

Gemini (Google Search)

Grok (xAI)

Kimi (Moonshot)

Perplexity Search

Skip for now选择Skip for now,后续再配置。

8. 是否安装skills

选择NO,有需要再安装吧。

9. 开启hooks

空格选择

选择Skip for now

10. 启动网关

Restart

Reinstall

Skip选择Restart,重启网关。

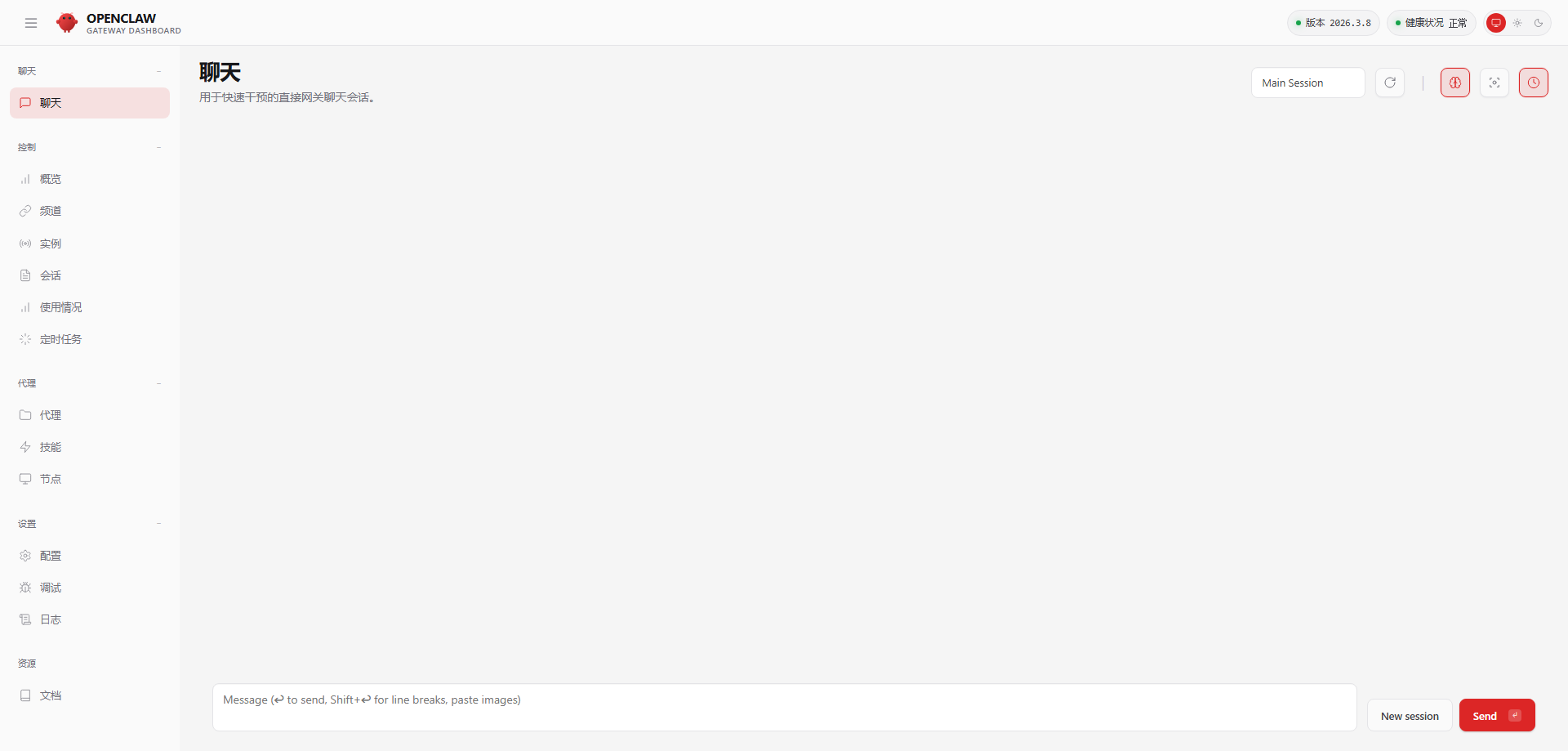

10. 如何打开网关

Hatch in TUI (recommended)

Open the Web UI

Do this later选择Open the Web UI,打开Web UI。

这里就快速把龙虾运行起来了。

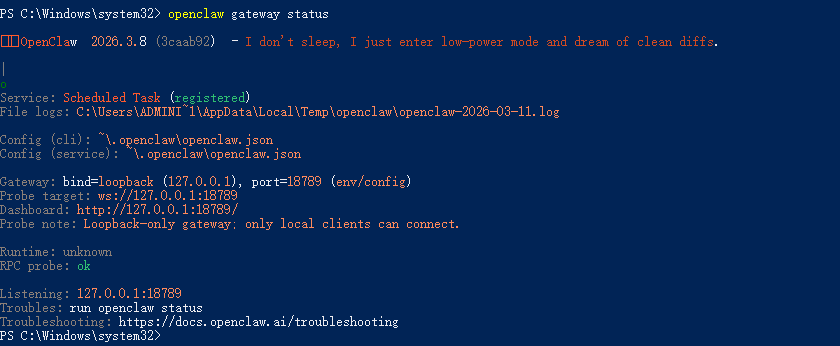

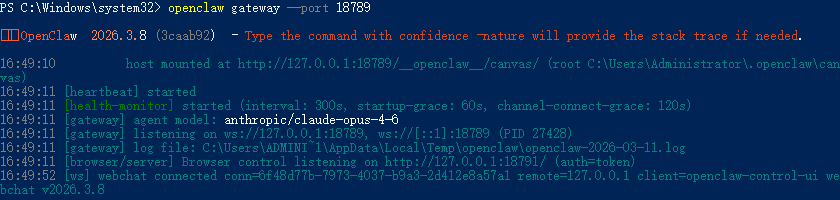

检查网关

如果您已安装该服务,它应该已经在运行了。

openclaw gateway status

打开控制界面

openclaw dashboard如果网关没有启动,可以手动运行。

openclaw gateway --port 18789

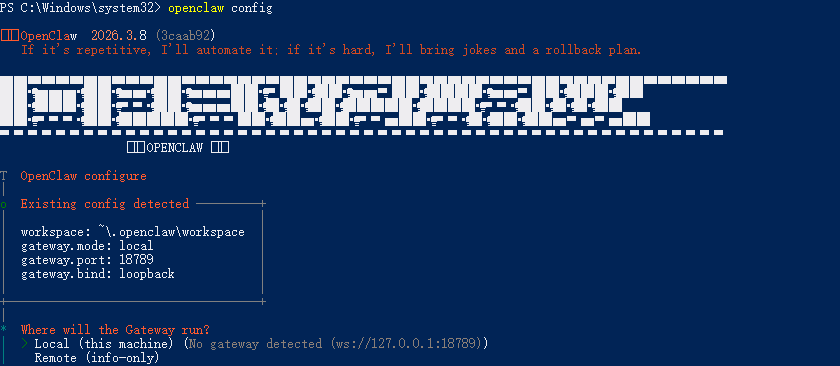

配置模型

您需要配置大语言模型的API密钥,用于调用模型。

openclaw config

1. 网关在哪里运行

Local (this machine) (No gateway detected (ws://127.0.0.1:18789))

Remote (info-only)选择Local (this machine),在本地运行网关。

2. 选择配置项

# 工作区

Workspace (Set workspace + sessions)

# 模型

Model

# web工具

Web tools

# 网关

Gateway

# 守护进程

Daemon

# 通讯渠道

Channels

# skills

Skills

# 健康检查

Health check

# 继续

Continue选择Model,配置模型。

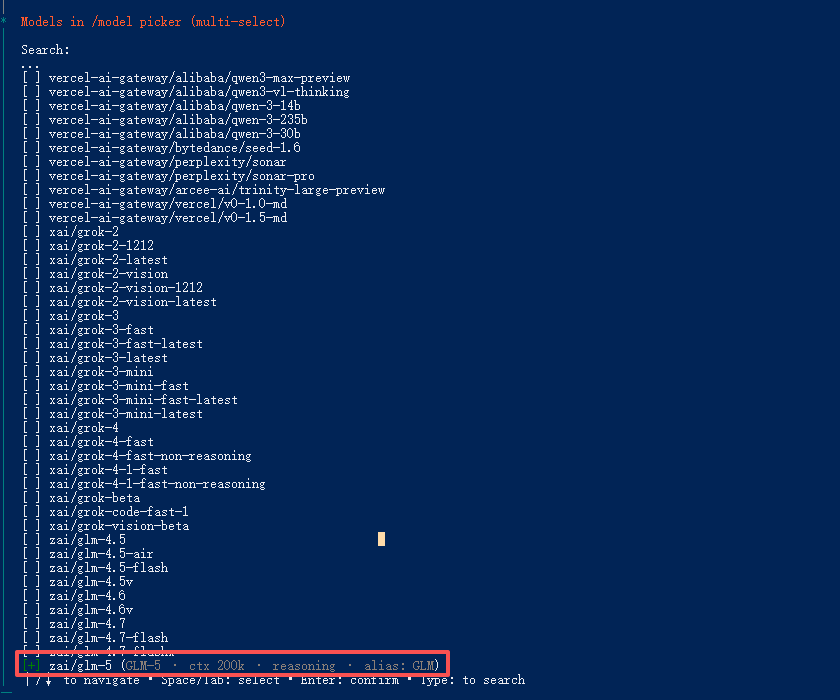

3. 配置模型

选择后就回到之前选择模型/服务提供商的步骤。

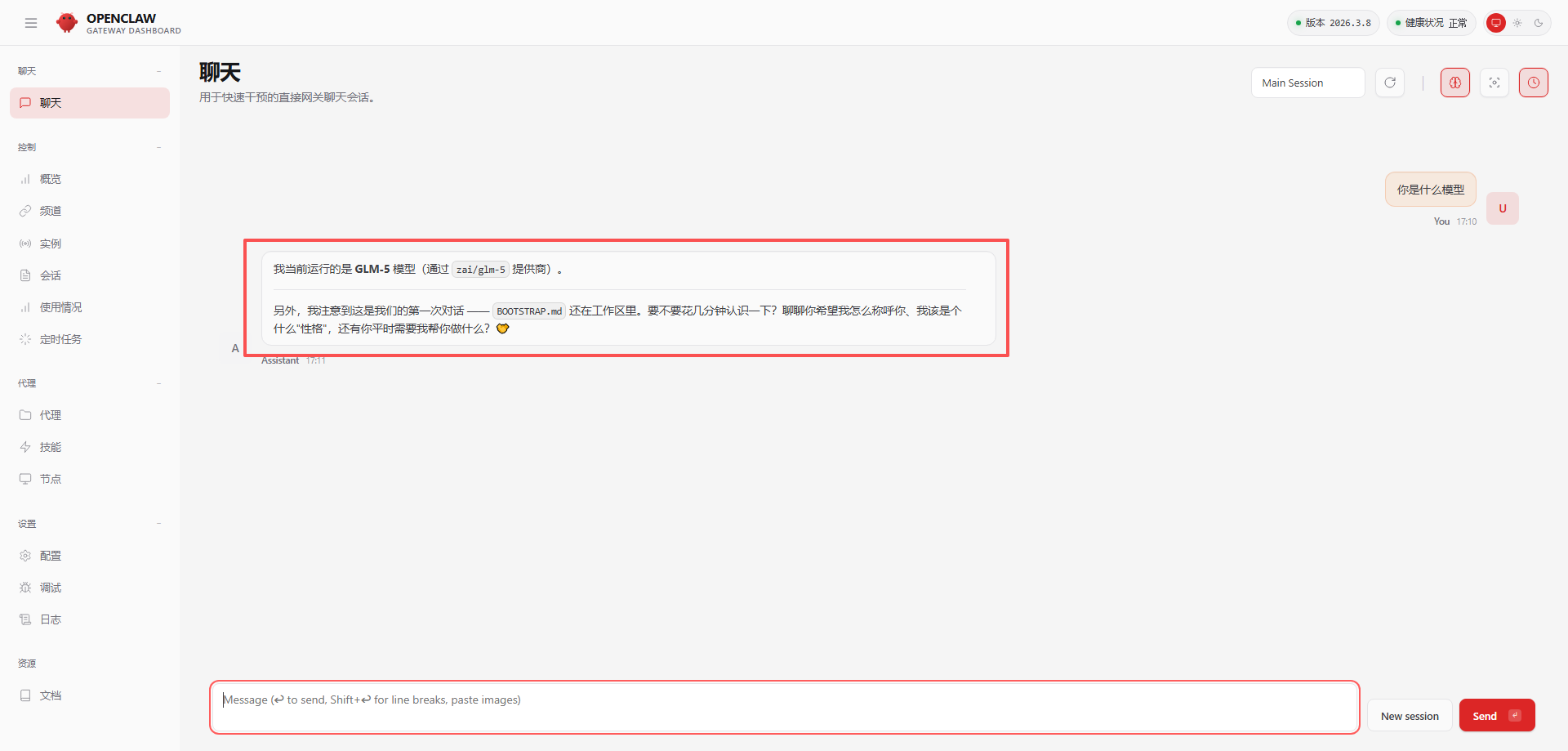

选择Z.AI,使用GLM模型。

4. 模型验证方法

Coding-Plan-Global (GLM Coding Plan Global (api.z.ai))

Coding-Plan-CN

Global

CN

Back选择CN,验证模型。

5. 配置API密钥

Paste API key now (Stores the key directly in OpenClaw config)

Use external secret provider选择Paste API key now,粘贴API密钥。

打开智谱AI网站,https://open.bigmodel.cn/,获取API密钥。

6. 选择模型

粘贴API密钥,后会自动选择对应的模型,直接回车就好。

7. 测试模型

这样就配置好模型了。